Raccolta illecita di dati personali. Questa la motivazione dietro allo stop a ChatGPT disposta dal Garante della Privacy.

Il Garante per la protezione dei dati personali stabilisce quindi una limitazione per OpenAI, la società statunitense proprietaria della piattaforma, che proprio qualche giorno fa ha rilasciato la sua nuova versione potenziata, GPT4.

>>Spingiti oltre i tuoi limiti con il Corso AI Marketing di Ninja Academy: porta nella tua professione digitale le potenzialità di ChatGPT e delle Intelligenze Artificiali e dai un boost alle tue strategie<<

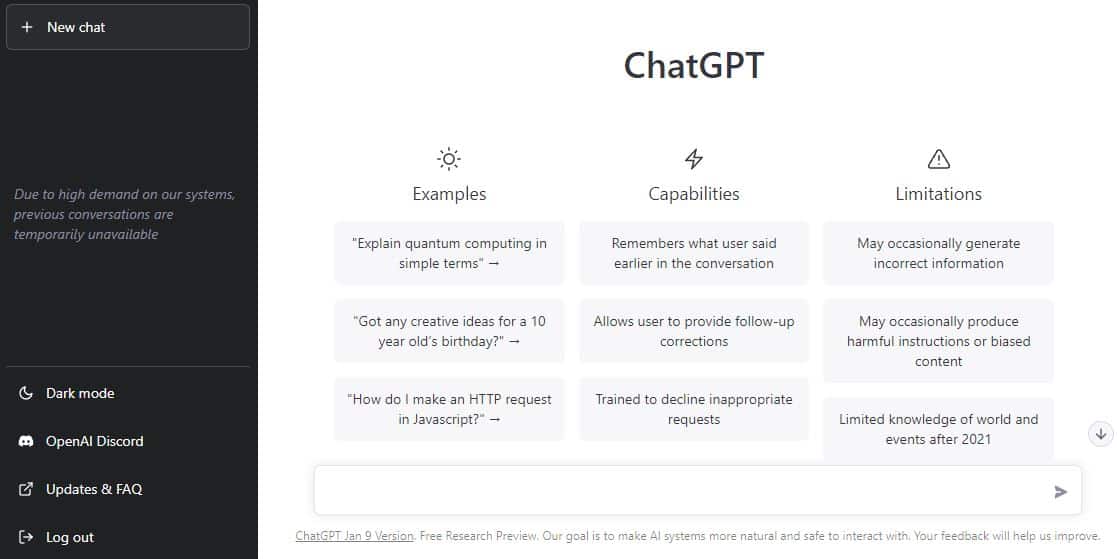

La piattaforma, che ha avuto il merito di rendere mainstream l’utilizzo dell’intelligenza artificiale applicata ai testi e divenuta probabilmente

l’applicazione più nota di questa tecnologia, aveva subito una perdita di dati lo scorso 20 marzo.

Dati che riguarderebbero le chat create dagli utenti nell’interrogazione dell’Intelligenza artificiale e anche le informazioni relative al pagamento per gli abbonati al servizio premium.

LEGGI ANCHE: OpenAI lancia GPT-4: la nuova generazione di Intelligenza Artificiale

Tuttavia, al momento in cui scriviamo il servizio risulta ancora disponibile.

LEGGI ANCHE: OpenAI lancia GPT-4: la nuova generazione di Intelligenza Artificiale

Tuttavia, al momento in cui scriviamo il servizio risulta ancora disponibile.

Cosa contesta il Garante a ChatGPT

Causa dello stop a ChatGPT sarebbe la mancanza di una informativa puntuale agli utenti e agli utilizzatori i cui dati vengono raccolti da una società che ha sede fuori dalla Comunità Europea (OpenaAI, appunto) e l’assenza di una base giuridica che giustifichi la raccolta e la conservazione massiccia di dati personali.

Stop a ChatGPT: la questione anagrafica

Altro punto dolente su cui si basa lo stop a ChatGPT da parte del Garante è la protezione dei più giovani: nonostante il servizio sia rivolto ai maggiori di 13 anni, non esiste in realtà alcun filtro di verifica per evitare che chi non raggiunge questa soglia utilizzi il servizio.

Che succede ora

Ora OpenAI avrà 20 giorni di tempo per comunicare al Garante le misure intraprese in attuazione di quanto richiesto, pena una sanzione pena una sanzione fino a 20 milioni di euro o fino al 4% del fatturato globale annuo.

L’azienda, che non ha una sede nell’Unione, ha però designato un rappresentante nello Spazio economico europeo.

Il commento di Massimiliano Masnada, Partner di Hogan Lovells

«L’intervento del Garante anzitutto sembra contestare a ChatGPT la mancanza di trasparenza, intesa come mancanza di informativa agli utenti rispetto alle finalità e modalità del trattamento dei dati personali eventualmente comunicati.

Il provvedimento, inoltre, richiama la necessità che sia individuata una base giuridica rispetto alla legittimità del trattamento da parte di OpenAI dei dati personali eventualmente raccolti dagli utenti. Infine, il Garante lamenta una mancanza di trasparenza sui filtri e altri meccanismi adottati da ChatGPT per impedire ai minori di 13 anni di utilizzare il servizio. Quest’ultimo punto, peraltro, accomuna l’intervento del Garante nei confronti di ChatGPT a quello che, a suo tempo, fece nei confronti di TikTok.

Il provvedimento odierno, che – va ricordato – ha natura temporanea di blocco del trattamento ma non implica necessariamente un divieto definitivo all’uso del servizio, pone numerose riflessioni, al di là delle misure specifiche che saranno intraprese da OpenAI per superare il blocco del Garante, sul futuro dei meccanismi di AI e su quanto è necessario fare per creare una cultura di legalità rispetto al loro utilizzo.

Non bastano, ad opinione di chi scrive, i pur necessari meccanismi di privacy by design e privacy by default ovvero i controlli e i rimedi per tutelare la privacy degli interessati, specie se minori. Occorre creare una nuova cultura tecnologica che si fondi sull’etica e sul rispetto dei diritti fondamentali.

Non è questo il luogo, né sarei in grado di dare indicazioni e, tanto meno, soluzioni, certo che un certo tipo di “pessimismo di maniera” connesso all’evoluzione degli strumenti tecnologici alimenta solo la paura e la preoccupazione senza essere utile in alcun modo a sviluppare una cultura della legalità.

Occorre, a mio parere, abbracciare il progresso pur mantenendo lo spirito critico necessario per evitare usi distorti e dannosi. In tal senso, credo sia importante diffondere informazioni in modo quanto più neutro possibile, raccogliere preoccupazioni e opinioni, porre i problemi per cercare le soluzioni.

Tutto ciò non può prescindere da un dati incontrovertibile. I dati, a prescindere che siano personali o meno, sono il carburante necessario per lo sviluppo di meccanismi di AI come ChatGPZ.

L’accesso ai dati consente di avere algoritmi più precisi ed idonei all’utilizzo per migliorare la vita delle persone. Il loro deve avvenire in modo sicuro ed etico. Per fare ciò non bastano i divieti.

Un primo passo, in tale senso, sarà la corretta implementazione delle regole sul riuso dei dati che sono alla base del Data Governace Act, di prossima entrata in vigore, e del successivo Data Act.

La giostra è appena partita».

LEGGI ANCHE: OpenAI lancia GPT-4: la nuova generazione di Intelligenza Artificiale

Tuttavia, al momento in cui scriviamo il servizio risulta ancora disponibile.

LEGGI ANCHE: OpenAI lancia GPT-4: la nuova generazione di Intelligenza Artificiale

Tuttavia, al momento in cui scriviamo il servizio risulta ancora disponibile.